22 días más tarde me cruzo con nuevas ideas.

El dilema: ¿el todo o las partes?

Y desarrollo un poco más...

Cómo analizar una imagen o una realidad? Partiendo de una imagen simple como la siguiente explico más a dónde quiero llegar:

Qué es esto? es un cuadrado rojo sobre un fondo azul? es un cuadrado lo rojo o es un conjunto de líneas negras con una superficie roja? o es acaso un montón de puntos rojos juntos que dan lugar a un cuadrado? o son los pixeles rojos que forman a los puntos rojos que forman al cuadrado rojo?

Qué define a qué? el todo del cuadrado a la idea del cuadrado o los pixeles juntos de determinado color definen al cuadrado rojo? qué es lo que vemos nosotros: un cuadrado rojo o un conjunto de pixeles rojos? y hasta qué extremos llevamos el análisis de las partes de lo que vemos? hasta el pixel último? hasta el conjunto de pigmentos que dan lugar al pixel? por qué parar en uno o en otro? por qué no? Por qué vemos el cuadrado rojo y no la idea de la imagen total? En este caso se trata de una imagen abstracta, pero si fuera una imagen figurativa como esta?:

Vemos un cuarto? vemos una cama, una silla, una mesa, todo por separado? vemos el cuarto o vemos la casa? o vemos el barrio de casas? cuándo o bajo qué condición decidimos poner el límite de nuestra percepción de lo que vemos? Por qué no veo la astilla de la cama? o el conjunto de maderas del piso por separado? por qué no vemos los pigmentos de azul de la pintura de la pared?

Qué define la esencia de las cosas que vemos? O las diferentes esencias generan esencias mayores? Qué nos hace ver unas u otras esencias? Qué esencia vemos o percibimos es la que debería ser generada como esencia en la experiencia auditiva. Genero entonces el sonido referente al concepto de "cama" o al concepto de "astilla"? Si es el de cama, qué color debería ser el que se convierta en sonido? el de la sábana o el de las maderas? Ninguno de estos dos por sí solos hacen a la cama, pero en conjunto generan esa percepción del concepto y esencia de cama. Lo mismo con el dormitorio...puede ser un cuarto o un dormitorio según lo que tenga adentro del mismo.

Creo que todas estas preguntas son válidas a la hora de tomar una decisión del análisis de las formas y composiciones de las imágenes que se interpretarán luego en este proyecto.

Y estas preguntas son básicamente para imágenes en dos y tres dimensiones, pero qué pasa cuando metemos una cuarta dimensión como es el tiempo? La percepción del tiempo muchas veces puede ser alterada por quien la percibe, más allá de que hay formas de medirla, a veces un escenario aburrido puede ser mucho más largo que uno interesante. Cómo influye esto en este proyecto? Se puede hacer una correlación lineal entre el tiempo de esta cuarta dimensión de la imagen hacia el tiempo de ejecución de la experiencia auditiva? Hace sentido que sea lineal?

Entonces, qué es más importante: el todo o las partes que conforman a ese todo? y hasta dónde podemos definir a las partes y a ese todo?

domingo, 25 de abril de 2010

sábado, 3 de abril de 2010

Cosas que encontré...

dando vueltas por la web me topé con dos sitios relacionados con R.S.

- http://www.nicolasfournel.com/audiopaint.htm

Se trata de un software que traduce imagenes en sonidos. La teoría que utiliza es diferente a la que planteo...tiene algunas diferencias, pero está bueno. Puede servir como punto de comparación respecto del final de mi proyecto.

- http://www.seeingwithsound.com/

Es una interfaz (anteojos conectados a una PC) entre lo que capta una cámara (en los anteojos) y el sonido que transmite. Está planteado como medio de sinestesia artificial. No explica muy bien cómo es que traduce las imágenes a sonidos. Acá explican cómo funciona: http://www.seeingwithsound.com/im2sound.htm

- http://audizer.deptof.com/

El mejor que encontré hasta ahora. Es muuuuy similar a lo que planteo. Tiene como parámetro que lee pixel por pixel en sentido Izq. a Der. de arriba a abajo. Eso me parece lo único cuestionable. Más allá de eso, está buenísimo!

mi proyecto está muerto?

viernes, 2 de abril de 2010

Correción a la Propuesta N°1

Algunas cuestiones surgieron a partir de charlas y pensamientos respecto a la propuesta N°1.

De ahí que habría que corregir algunas pautas...o reformular la propuesta N°1.

Basicamente hay que relacionar color y sonido. Para eso creo que habría que tomar las propiedades que definen a cada uno de los dos e interrelacionar esas propiedades para luego generar algún tipo de algoritmo que convierta uno a otro.

Empezando por el sonido, sus cuatro cualidades básicas son la altura, la duración, el timbre y la intensidad, fuerza o potencia.

El color, en cambio, como habíamos visto, se define por 6 parámetros:

Estos tres primeros están intimamente relacionados con Hue o tonalidad. De hecho, la mezcla de ellos definirá sobre qué graduación de Hue se trabaje.

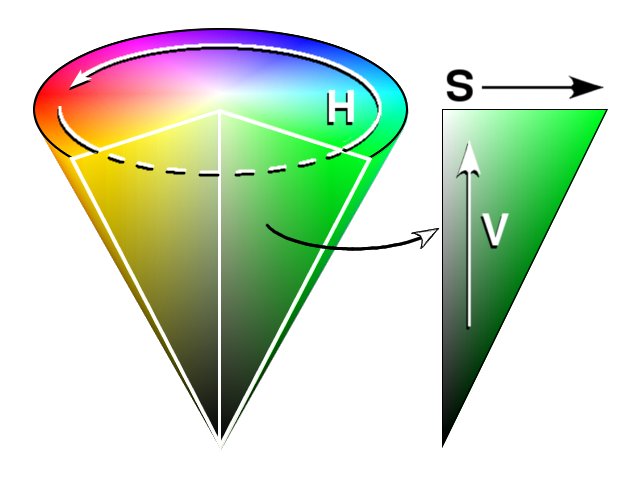

Estos últimos 3 parámetros vienen del modelo desarrollado por Alvy Ray Smith:

De ahí que habría que corregir algunas pautas...o reformular la propuesta N°1.

Basicamente hay que relacionar color y sonido. Para eso creo que habría que tomar las propiedades que definen a cada uno de los dos e interrelacionar esas propiedades para luego generar algún tipo de algoritmo que convierta uno a otro.

Empezando por el sonido, sus cuatro cualidades básicas son la altura, la duración, el timbre y la intensidad, fuerza o potencia.

| Cualidad | Característica | Rango |

|---|---|---|

| Altura | Frecuencia de onda | Agudo, medio, grave |

| Intensidad | Amplitud de onda | Fuerte, débil o suave |

| Timbre | Armónicos de onda o forma de la onda | Fuente emisora del sonido |

| Duración | tiempo de vibración | Largo o corto |

| Cualidad | Característica | Rango |

|---|---|---|

| Red | Cantidad de Rojo que tiene el color | de 0 a 255 |

| Green | Cantidad de Verde que tiene el color | de 0 a 255 |

| Blue | Cantidad de Azul que tiene el color | de 0 a 255 |

Hue | Tonalidad, el tipo de color | de 0° a 360° |

Saturation | Distancia al eje de brillo negro-blanco | de 0% a 100% |

Brigthness o Value | Brillo del color. La altura del eje negro-blanco | de 0% a 100% |

Hue deberá definir la tonalidad de la nota. Esto irá de acuerdo a la escala propuesta por Sciabrin:

Por tanto un rojo será interpretado por DO. Un azul por SI. Un violeta podría ser por un acorde entre DO y SI. Dependiendo en qué lugar de la escala 0° a 360° esté, la mezcla de tonos que tendría en cuanto sonido.

Saturation podría traducirse en la propiedad de Intensidad del sonido. Un color más saturado tendría pues una mayor intensidad o amplitud de onda. Si la saturación va de 0 a 100%, la amplitud de onda va de 0 a 140 dB

Brightness o Valor debería traducirse en la altura o frecuencia fundamental de la onda sonora que se emita. Así, mayor valor generaría una frecuencia de onda sonora mayor.

Aún quedan dos parámetros del sonido para ser definidos en la traducción de una imagen. Creo que Timbre y Duración dependerán más de la forma que se está analizando más que del color. De hecho podría llegar a ser el nexo entre forma y color dado que estos son dos y el sonido es uno.

Etiquetas:

Brightness,

color,

Duración,

forma,

frecuencia,

Hue,

propiedades del color,

propiedades del sonido,

Saturation,

Timbre,

Value

jueves, 1 de abril de 2010

Propuesta N°1

Luego de leer un rato cosas en internet me inspiré para elaborar la propuesta N°1.

Utilizando el cubo de RGB en conjunto con la Asociación de Sciabrin entre notas y colores se definirá el sonido apropiado para cada color.

Esto puede llegar a resultar contrario a lo establecido por Kandinsky, pero es cuestión de probarlo.

El método que propongo es el siguiente:

- Utilizando el cubo RGB estableceremos de qué color se está tratando exactamente.

Técnicamente, se puede identificar este color con las coordenadas de bits siguientes:

Red: puede ir de 0 a 255

Green: puede ir de 0 a 255

Blue: puede ir de 0 a 255

Hue: puede ir de 0 a 359

Saturation: puede ir de 0% a 100%

Brightness: puede ir de 0% a 100%

De acuerdo a estos parámetros que defina el sistema según cómo lo reconoce (tal vez utilizando el cuentagotas típico) se lo definirá dentro del cubo.

- La escala de Sciabrin es la siguiente:

De acuerdo al color que se determina dentro del cubo RGB se disparará la nota correspondiente a esta escala.

Podría generarse un dodecaedro con estos 12 colores para generar más precisión. La distancia entre punto de color y punto de color debería hacerse de acuerdo a la paleta de colores RGB. Se puede llegar a ampliar el cubo que tenemos hoy agregando puntos a la distancia que corresponda para encontrar esos colores.

- Cada tecla debería tener una amplitud de volúmen que va desde 0 a 255 de manera tal que el 0 (Negro=Oscuridad) es el silencio y el 255 (Blanco=Luz plena) es el volúmen máximo. En 0 no se oye. En 0 no hay luz. En 0 no hay color. En 255 sucede lo contrario. De esta manera se generaría un sonido final a partir de un acorde generado por las distintas teclas presionadas con sus volúmenes correspondientes. Ese sería el sonido del color de ese pixel que estamos analizando.

El volumen estaría determinado por la posición del color dentro del dodecaedro o del cubo en base a su posición en 12D (todavía no estoy muy seguro que sean 12D o 3D)...o sea de acuerdo al valor de ese punto dentro de los 12 ejes para llegar al color definido.

Podría llegar a testearse lo mismo pero reemplazando al cubo RGB por el CYMK y ver los resultados que este método arroja. Hay ciertas diferencias, pero estimo no serán muy diferentes dado que existe una relación matemática de conversión entre RGB y CYMK.

Etiquetas:

CYMK,

Kandinsky,

Propuesta N°,

RGB,

Sciabrin

Suscribirse a:

Comentarios (Atom)